카르파시 "2025년은 LLM이 '유령'이라는 것을 확인한 해"

🎧 Voice Briefing

📅 Generated: 2025. 12. 26. 오전 8:33:01

⏱️ Duration: ~66s

Links: 🔗 Open in Google Drive | 📥 Download

(사진=X, Andrej Karpathy)

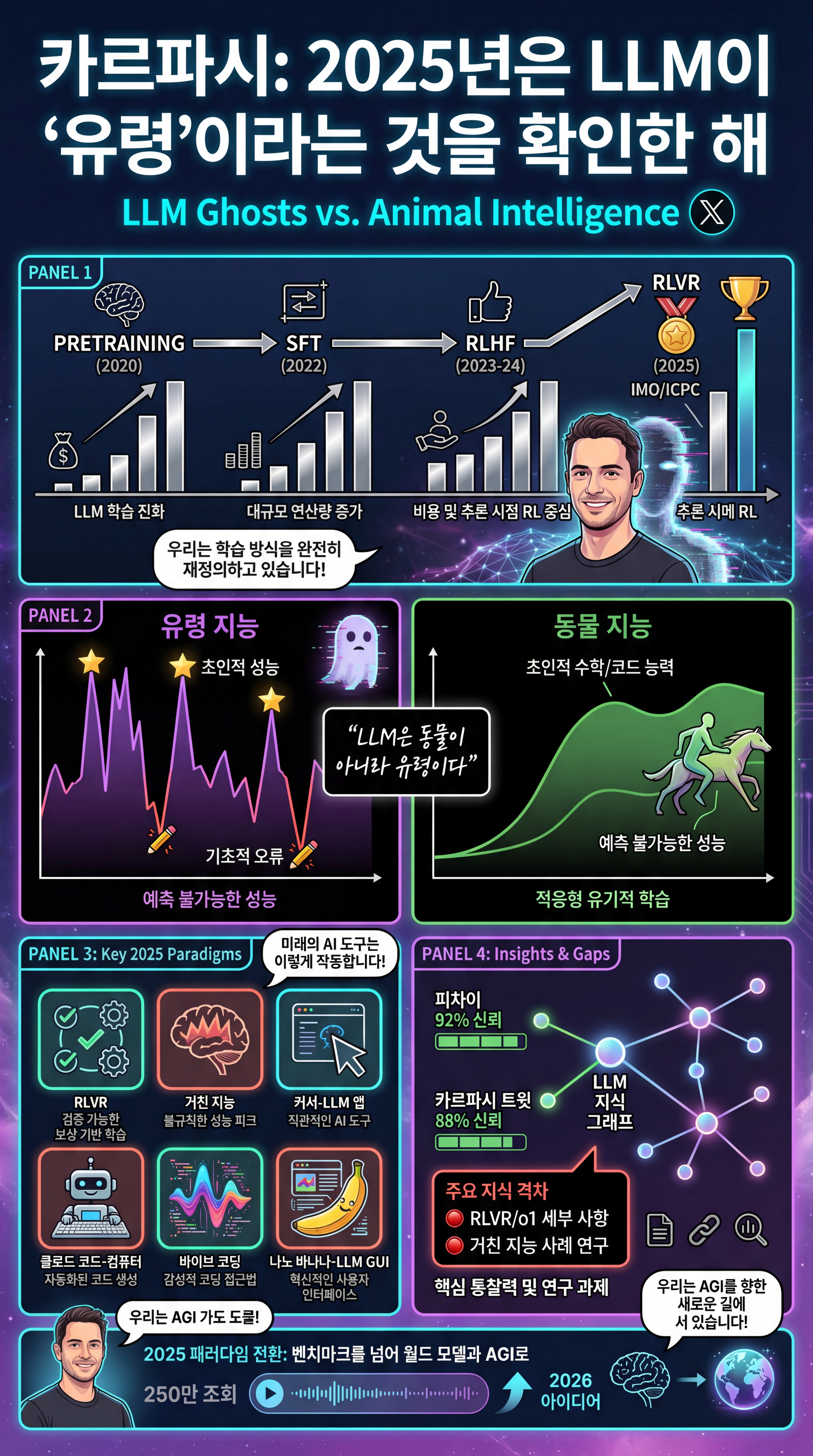

'바이브 코딩' 용어 창시자인 안드레이 카르파시 오픈AI 공동 창립자가 2025년 AI의 특징을 정리했다. 이 가운데 대형언어모델(LLM)의 지능이 우리의 예상과는 달랐다는 점을 강조하며, 이를 '유령(Ghosts)'에 비유했다.

카르파시 유레캅 랩스 CEO는 20일(현지시간) X(트위터)를 통해 '2025년 LLM 연간 리뷰'라는 글을 게시했다.

그는 2025년을 LLM 분야에서 눈에 띄고 의미 있는 발전이 이루어진 한해라고 평했다. 이에 따라 개인적으로 주목할 만한 '패러다임 변화'를 정리했다고 전했다.

여기에는 ▲검증 가능한 보상을 활용한 강화 학습(RLVR) ▲들쭉날쭉한 지능(Jagged Intelligence) ▲커서-LLM 앱의 새 레이어 ▲클로드 코드-컴퓨터에 존재하는 AI ▲바이브 코딩 ▲나노 바나나-LLM GUI 등이 포함됐다.

이중 커서와 클로드 코드, 바이브 코딩 등은 AI 코딩 능력의 향상과 이를 활용한 새로운 LLM 앱의 가능성, 에이전트 능력의 향상 등을 다룬 내용이다. 그리고 나노 바나나는 단순한 이미지 생성 모델을 넘어, 텍스트와 이미지, 세계 지식 등이 모두 통합된 'LLM GUI(그래픽 사용자 인터페이스)'의 가능성을 보여주는 초기 단계로 높게 평가했다.

핵심은 RLVR과 들쭉날쭉한 지능에 대한 부분이다.

그는 LLM의 훈련이 기존의 '사전 학습→SFT(지도 미세조정)→RLHF(인간 피드백을 통한 강화 학습)'를 넘어, 올해에는 RLVR(Reinforcement Learning from Verifiable Rewards)이 추가됐다고 밝혔다.

2020년까지는 사전 학습이 주를 이뤘지만, 이후 2022년까지는 SFT에 집중했으며, 오픈AI의 '챗GPT' 성공으로 RLHF가 지난해까지 가장 중요한 훈련법으로 자리 잡았다는 것이다. 그리고 올해에는 RLVR이 4번째 단계로 본격 부각된 것으로 봤다.

RLVR은 지난해 말 오픈AI가 'o1' 모델을 개발하며 초점을 맞춘 것으로 알려진 강화 학습(RL)이 특정 도메인에 집중됐다는 것을 설명한 것이다. 실제로 오픈AI와 구글은 이를 통해 국제수학올림피아드(IMO)와 국제대학프로그래밍대회(ICPC)에서 금메달을 따내기도 했다.

RLHF가 주관적인 인간의 선호도에 의존했다면, RLVR은 '객관적인(조작 불가능한) 보상 함수'를 사용한다. 이는 LLM이 '무엇이 좋은 응답인지'를 인간 판단을 거치지 않고 환경 자체로부터 직접 학습할 수 있게 한다.

특히, 수학이나 코드와 같이 자동으로 정답을 검증할 수 있는 환경에서 유용하다. 이를 통해 LLM은 보상 최적화를 통해 최적의 방식을 스스로 찾아내고, 인간의 추론과 비슷한 능력을 자발적으로 개발한다.

또 이런 방식을 통해 LLM의 성능 향상은 기존의 모델 크기가 아닌, RL 실행 시간(테스트-타임 컴퓨팅)으로 확장됐다. 이는 컴퓨팅 자원이 사전 학습에서 고비용 추론으로 재분배됐다는 것을 시사한다

하지만, 카르파시 CEO는 이렇게 진화한 LLM의 지능을 유령에 비유했다. 이는 AI가 진화하고 성장하는 '동물(Animals)', 즉 인간과 흡사할 것으로 예상했던 것과는 다르다는 말이다.

인간의 지능은 생존과 환경 적응, 경험을 통해 균형 있게 성장하는 유기체적 지능이지만, AI가 이와 흡사할 것이라고 생각했던 것은 오판이었다는 것이다.

LLM 지능은 특정 데이터와 알고리즘, RLVR 등을 반영한 결과로, 유령처럼 갑자기 불완전한 상태로 등장한 비유기체적 존재라는 것이다. 목적 함수를 과하게 최적화한 결과물일 뿐 범용적인 적응력을 갖춘 생명체가 아니며, 그 지능은 훈련 스택에 의해 협소하게 정의된다는 것이다.

그 결과 LLM은 "우스꽝스러울 정도로 들쭉날쭉한 성능 특성을 가졌다"라고 지적했다. RLVR의 결과로 수학이나 코딩 등 검증 가능한 도메인에서는 인간의 능력을 뛰어넘지만, 초등학생도 풀 수 있는 간단한 문제도 해결하지 못할 경우가 많다는 것이다.

카르파시가 지적한 '유령'과 '동물' 지능의 차이

사실 LLM의 급속한 발전으로 인간과 같은 인공일반지능(AGI)에 이른 시일내 근접할 수 있을 것이라는 기대가 크다. 하지만, 최근에는 AGI에 도달하기 위해서는 LLM만으로는 부족하며, 세계 상식을 갖추기 위한 월드 모델이 중요성도 강조되고 있다.

카르파시 CEO는 LLM의 성능을 가늠하는 벤치마크에 대한 근본적인 문제도 지적했다. 현재 벤치마크는 단지 '검증 가능한 테스트 영역'을 다루는 것일 뿐, 여기에서 높은 점수를 얻었다고 인간 수준의 일반화와 유연성, 상식, 적응력을 갖췄다는 것이 아니라는 것이다. 또 RLVR을 통해 벤치마크에 최적화된 모델이 계속 등장한다고 지적했다.

그는 "2025년에도 벤치마크에 대해 전반적으로 관심이 없어졌고, 결과에 대해 신뢰하지도 않았다"라고 말했다.

이처럼 그는 강화 학습을 통한 LLM의 눈부신 발전은 인간 지능의 모방이 아닌, 협소한 목적 함수에 대한 극단적인 최적화의 결과물이라고 지적했다. 이에 따라 2025년의 가장 큰 개념적 변화는 '지능'이라고 부르는 것의 형태가 완전히 다를 수 있다는 인식이며, 이는 기존의 벤치마크 중심의 평가 방식을 무력화시켰다는 것이다.

들쭉날쭉한 지능이라는 개념은 앞서 순다르 피차이 구글 CEO도 지적했던 부분이다. 일리야 수츠케버 오픈AI 공동 창립자도 "LLM은 외계인(LLMs are aliens)"이라는 발언을 내놓은 바 있다.

이처럼 카르파시 CEO의 글은 LLM의 본질에 집중한 것으로 볼 수 있다. 이 글은 전문적인 내용임에도 불구, 250만건의 조회수와 1만4000건의 '좋아요'를 받았다.

이는 그의 글이 업계의 공감대를 형성했으며, 2026년에는 기존 LLM의 한계를 넘을 아이디어와 '유령' 지능을 평가할 새로운 방법론이 필요하다는 의미로 해석할 수 있다.

임대준 기자 ydj@aitimes.com

🧠 Connected Insights

📅 Last analyzed: 2025. 12. 26. 오전 8:30:01

💰 Analysis cost: $0.0214

🔗 Related Notes

-

- supports: 분석 노트에서 카르파시가 언급한 '들쭉날쭉한 지능(Jagged Intelligence)' 개념을 순다르 피차이 구글 CEO도 지적했다고 명시적으로 참조하며, LLM 지능의 불균형성을 공통으로 강조함.

- Confidence: █████ (92%)

-

🔼 Tweet_by_Andrej_Karpathy_뉴스인사이트

- extends: 안드레이 카르파시의 트윗과 직접 관련된 노트로, 그의 AI 관점(예: 바이브 코딩 등)을 확장하며 본 노트의 2025 리뷰(바이브 코딩, RLVR 등)를 보완함.

- Confidence: ████░ (88%)

-

🔗 Ontology is having its moment.

- related: LLM의 환각(hallucination) 문제를 온톨로지로 해결한다는 내용이 분석 노트의 '유령' 지능(불완전하고 협소한 지능)과 벤치마크 한계, 월드 모델 필요성에 개념적으로 연결됨.

- Confidence: ████░ (75%)

-

✅ Do the Thinking Models Actually

- supports: LLM(Thinking Models)의 진짜 '생각' 여부를 의문시하는 내용이 카르파시의 '유령' vs '동물' 지능 비유와 일치하며, LLM 지능의 비유기적·불완전한 본질을 지지함.

- Confidence: ████░ (82%)

-

🔗 Two_useful_AI_tactics_뉴스인사이트

- related: LLM 활용 전술을 다루며 바이브 코딩 등 카르파시가 언급한 패러다임 변화(커서-LLM 앱, 바이브 코딩)와 유사한 실용적 응용 측면에서 연결됨.

- Confidence: ███░░ (65%)

📚 Knowledge Gaps

-

🔴 RLVR(Reinforcement Learning from Verifiable Rewards)의 구체적 구현 사례와 o1 모델 상세 분석

- 분석 노트에서 RLVR을 2025 핵심으로 강조하나 세부 메커니즘(보상 함수 설계, 테스트-타임 컴퓨팅 최적화)과 오픈AI o1의 성능 데이터가 부족해 LLM 훈련 패러다임 전환 이해에 필수적임.

- Suggested resources: OpenAI o1 기술 보고서, Google DeepMind RLVR 관련 논문 (IMO/ICPC 성과 분석)

-

🔴 Jagged Intelligence의 구체적 예시와 벤치마크 대안 평가 방법론

- 들쭉날쭉한 지능을 지적하나 실제 실패 사례(초등 문제 실패 등)와 새로운 평가 프레임워크(상식·적응력 테스트)가 미흡해 LLM의 실세계 일반화 한계를 탐구해야 함.

- Suggested resources: Karpathy의 원본 X 포스트 (https://x.com/karpathy/status/2002118205729562949), Sundar Pichai 인터뷰 풀 텍스트

-

🟡 LLM '유령' 지능을 넘어선 월드 모델(World Model) 통합과 AGI 경로

- 노트에서 AGI 위해 월드 모델 중요성 언급하나 LLM+월드 모델 아키텍처 예시(나노 바나나 등)가 초기 단계로 그쳐, 2026년 초석으로서 깊이 탐구 필요.

- Suggested resources: Ilya Sutskever의 'LLMs are aliens' 발언 관련 자료, xAI Grok 월드 모델 연구

-

🟡 2026년 LLM 한계 극복 아이디어와 새로운 평가 방법론

- 카르파시가 2026 필요성 시사하나 구체적 제안(온톨로지, 에이전트 등)이 없어 미래 트렌드 예측에 지식 갭 발생.

- Suggested resources: Palantir Ontology in Enterprise AI 사례, Anthropic/Claude 코드 에이전트 업데이트

💡 AI Insights

이 노트는 2025년 LLM 발전(RLVR, 바이브 코딩 등)을 축하하면서도 '유령' 비유를 통해 지능의 비유기적·협소한 본질을 재정의하며, 벤치마크 중심 평가의 한계를 드러냄. 이는 업계 공감(250만 조회)을 불러일으키며, 단순 스케일링 넘어 월드 모델·온톨로지 등 구조적 혁신 필요성을 강조하는 패러다임 전환 신호.