AI 인지부채의 시대: 당신의 뇌가 조용히 무너지는 5가지 신호

🎧 Voice Briefing

📅 Generated: 2026. 5. 7. 오전 8:33:10

AI 인지부채의 시대: 당신의 뇌가 조용히 무너지는 5가지 신호

프롤로그: 당신은 정말 '일'을 하고 있는가?

스크롤을 잠깐 멈춰보자.

내일 아침 모든 AI 도구가 사라진다고 해보자. 당신은 여전히 무엇을 만들 수 있는가? 여전히 어떤 글을 쓸 수 있는가? 어떤 문제를 채팅창 없이, 자동완성 없이, 혼자 풀어낼 수 있는가?

지난 일주일 동안 당신은 '생각'에 몇 시간을, '프롬프팅'에 몇 시간을 썼는가? 그 둘은 정말 같은 일인가?

대부분의 사람들은 이 질문 앞에 앉아있지 못한다. 답이 불편하기 때문이다. 그 불편함이 바로 신호다.

나는 3개월 전, 6주 전에 내가 직접 짠 함수를 멍하니 바라보고 있었다. 한 번 읽었다. 또 읽었다. 결국 채팅창을 열고 모델에게 "내가 쓴 코드를 설명해달라"고 부탁했다. 그 순간이 생각보다 무겁게 다가왔다 — 나는 몇 달 동안 '생산적'이라고 자부하면서, 정작 코드를 읽는 뇌의 일부를 꺼버리고 있었던 것이다.

"AI를 쓰는 데 중립적인 방법은 없다. 당신은 더 날카로워지거나, 더 텅 비어가거나 둘 중 하나다."

— Rohit Vichare[^1]

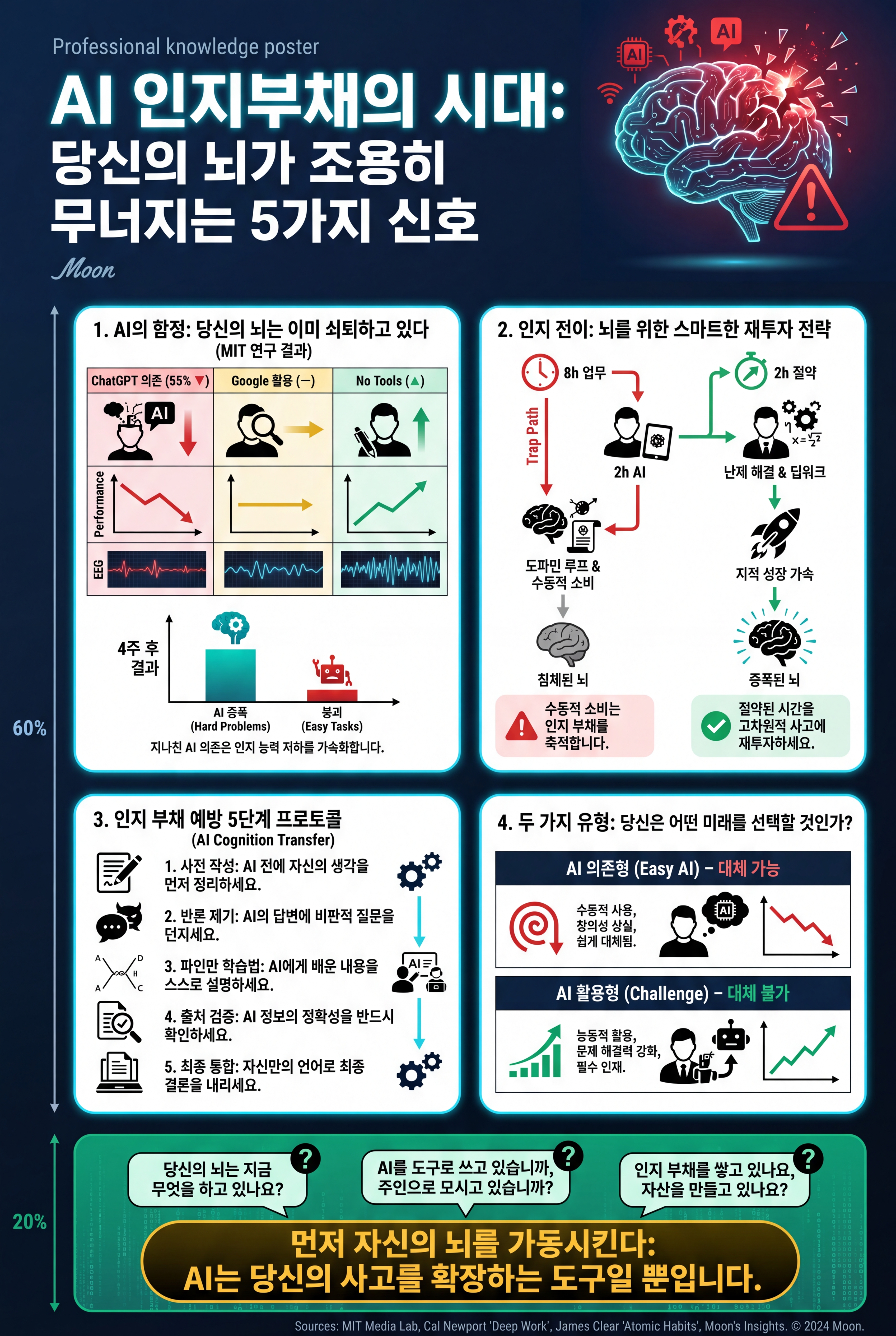

I – MIT가 EEG로 증명한 '인지부채'의 실체

2025년 6월, MIT Media Lab의 8명 연구진이 충격적인 논문을 발표했다. 54명의 대학생을 EEG 장비에 연결하고, 4개월간 3번의 에세이 작성 세션을 시킨 것이다.1

세 그룹으로 나눴다. ChatGPT 그룹, Google 검색 그룹, 아무 도구도 없는 그룹.

결과는 단호했다.

ChatGPT 사용자의 뇌 연결성은 매 세션마다 약화됐다. 직접 글을 쓴 그룹 대비 최대 55% 감소. 세션 3에 이르자 참가자들은 그저 복사-붙여넣기를 하고 있었다. 5분 전에 자기가 쓴 에세이에서 한 줄을 인용해보라고 하자, 78%가 한 줄도 떠올리지 못했다. 정확히 인용한 사람은 11%뿐이었다.

연구자들이 만든 용어가 바로 인지부채(Cognitive Debt)다. 오늘 더 빨리 출고하기 위해 자신의 사고력을 담보로 빌려 쓰는 것. 그 이자는 미래의 사고 능력 자체에 복리로 누적된다.

"AI는 중립적이지 않다. 이미 거기 있는 것과 상호작용한다.

당신이 아무것도 쌓아두지 않았다면, AI는 '아무것도 아닌 것'의 축적을 가속할 뿐이다."

그런데 진짜 핵심은 4번째 세션에 있었다

바이럴 트윗들이 놓친 부분이다. 연구자들은 4번째 세션에서 그룹을 바꿨다. 손글씨 그룹에게는 ChatGPT를 줬고, ChatGPT 그룹에게는 도구를 빼앗았다.

결과는 정반대로 뒤집혔다.

| 그룹 | 4세션 결과 |

|---|---|

| 🧠 손글씨 → AI | 알파·베타·세타·델타파 전대역에서 가장 높은 신경 연결성. AI가 기존 역량을 증폭 |

| 🤖 AI → 도구 제거 | 5분 전 자신의 글을 단 한 줄도 인용하지 못함 (78%). 도구가 사라지자 작동 불능 |

순서가 모든 걸 결정한다. 독립적 사고 이전에 AI를 쓰면 부채가 쌓인다. 독립적 사고 이후에 AI를 쓰면 증폭된다.

II – 전이된 인지: 당신의 사고는 어디로 갔는가

여기서 더 무서운 두 번째 데이터가 등장한다.

Microsoft Research가 2025년 CHI 컨퍼런스에서 발표한 연구는 319명의 지식 노동자, 936건의 실제 AI 활용 사례를 분석했다.2 결론은 간단했다. AI에 대한 신뢰가 높을수록, 비판적 사고는 낮아졌다.

업무는 '결과물 생산'에서 '결과물 검증'으로 옮겨갔다. 그리고 대부분은 검증조차 제대로 하지 않았다. 검증한 '느낌'만 있을 뿐이었다.

RAND가 2025년 12월 1,214명의 청소년에게 물었다.3 67%가 "AI를 많이 쓸수록 비판적 사고력이 손상된다"고 답했다. 10개월 전 54%에서 13%포인트 급증한 수치다. 그런데 같은 기간 AI 숙제 사용률은 48%에서 62%로 올랐다.

학생들은 알고 있다. 알면서도 쓴다.

graph LR

subgraph 함정 ["🔴 전이된 인지의 함정"]

A[8시간 업무] -->|AI로 압축| B[2시간 업무]

B -->|남은 6시간| C[스크롤·넷플릭스]

C --> D[뇌가 자라지 않음]

end

subgraph 활용 ["🟢 재투자의 길"]

E[8시간 업무] -->|AI로 압축| F[2시간 업무]

F -->|남은 6시간| G[더 어려운 문제]

G --> H[역량 복리 성장]

end

이게 바로 전이된 인지(Transferred Cognition)의 함정이다. 사고는 멈추지 않았다. 옮겨졌을 뿐이다. 한때 당신이 초안과 시행착오로 채우던 시간은 모델에게 넘어갔고, 그 시간이 비운 자리는 도파민으로 채워졌다.

도구는 같다. 결과는 정반대다. 차이는 오직 하나 — 절약한 인지 자원을 어디에 쓰는가.

III – 다시 사고하는 5단계 프로토콜

지난 3개월간 나는 내 자신의 붕괴를 역설계하며 사고 회로를 다시 만들었다. 이론이 아니다. 디버깅 직관을 이걸로 복구했다.

1️⃣ 먼저 생각하고, 나중에 프롬프트하라

비자명한 작업 앞에서 AI 도구를 열기 전에 10분간 자신의 거친 답안을 써라. 틀린 버전을 써라. 자신의 혼란을 나열하라. 답이 무엇일 거라 생각하는지, 왜 그렇게 생각하는지 문장으로 적어라.

그런 다음에야 채팅창을 열어라. 싸울 거리를 들고 들어가라.

비용은 하루 15분. 이익은 당신의 뇌가 커서가 되지 않고 루프 안에 남는다는 것이다.

2️⃣ AI에게 반대하라고 명령하라

언어 모델은 RLHF로 훈련되어 동의하도록 최적화되어 있다. 기본 응답은 검증의 한 형태고, 이건 기분만 좋게 할 뿐 아무것도 가르치지 않는다.

내가 매일 쓰는 스니펫은 이런 것이다:

"이 글을 정독하라. 가장 약한 주장 하나를 찾아 인용하고, 왜 약한지 설명하라. 내가 빈틈을 가리려고 쓴 수사적 장치를 찾아라. 구체적으로. 정중하게 굴지 마라."

이 프롬프트를 진지하게 처음 돌렸을 때, 모델은 내가 의식조차 못 했던 두 개의 가정을 끌어냈다. 그중 하나는 글 전체를 떠받치는 가정이었다. 이름이 붙는 순간 논증 전체가 무너졌다.

합의는 비싼 아첨이다. 학습은 불일치 안에 산다.

3️⃣ 흐름을 뒤집어라 — AI에게 가르쳐라

대부분 AI를 '교사'로 쓴다. 더 유용한 건 그 반대다. AI를 청중으로 삼아 설명하라.

파인만 기법이 효과적인 이유는, 설명이라는 행위가 자신의 모델 안 빈틈을 강제로 메우기 때문이다. 명료한 설명을 읽는 건 같은 효과를 내지 않는다. 친숙함을 만들 뿐이고, 친숙함은 '이해'의 가면을 쓴 환각이다.

자신이 안다고 생각하는 개념을 골라라. 똑똑한 12살에게 설명하듯 AI에게 풀어내라 — 단, 그 12살은 적대적 질문을 할 권한이 있다. 그런 다음 모델에게 부탁하라: "내 설명에서 모호하거나 손짓으로 넘긴 부분, 단계를 건너뛴 부분을 모두 찾아라. 명료성, 정확성, 완결성을 각각 점수 매기되 이유를 구체적으로."

틀린 시도가 옳은 버전의 인코딩을 예열한다. 틀린 시도를 건너뛰면 인코딩도 건너뛴다.

4️⃣ 핵심을 떠받치는 주장은 직접 검증하라

AI가 내놓은 답에서 세 가지 주장을 골라라. 만약 틀렸을 때 당신의 결정을 바꿀 그 세 가지를. 1차 자료를 열어라. 사실을 확인하거나 깨뜨릴 만큼 충분히 읽어라.

내가 이걸 배운 사건: 임베딩 모델 성능에 대한 글을 쓰던 중 AI가 자신감 있게 인용한 벤치마크 숫자가 있었다. 알고 보니 구버전 모델을 쓴 오래된 논문 출처였다. 하마터면 가짜 숫자를 내 이름으로 세상에 뿌릴 뻔했다. 20분의 출처 확인이 그걸 막았다.

확신에 찬 정답과 확신에 찬 오답을 똑같은 유창함으로 쏟아내는 도구 앞에서, 당신이 가진 가장 중요한 능력은 그 둘을 구분하는 능력이다.

5️⃣ 최종 합성은 채팅창을 닫고 써라

AI가 도와준 것이 무엇이든, 최종 출고물 — 결론 단락, 커밋 메시지, 계획서 — 은 채팅창을 닫고 기억에서 자기 말로 써라.

이 단계는 타협 불가다. 작업이 진정 당신 것이 되는 순간이다. 법적 의미에서도, 인지적 의미에서도.

두 달 전 내가 회사 전략 문서를 쓰면서 Claude로 30페이지를 깔끔하게 만들었다. 그런 다음 채팅을 닫고 빈 페이지를 열어 한 단락짜리 요약을 기억으로 써보려 했다. 세 군데가 틀렸다. 30페이지 동안 나는 타이피스트였다.

다시 처음부터 이 프로토콜대로 썼다. 최종본은 12페이지였고, 그건 내 것이었다. 3주 뒤에도 어느 줄이든 기억해서 인용할 수 있었다.

IV – 두 부류의 사람이 갈라지고 있다

LLM 시대 4년 차, 인구는 두 부류로 갈라지고 있다.

| 구분 | 첫 번째 부류 | 두 번째 부류 |

|---|---|---|

| AI 활용 | 같은 일을 더 쉽게 | 불가능했던 일에 도전 |

| 절약 시간 | 편안함에 소비 | 더 어려운 문제에 재투자 |

| 출력 | 동일 유지 | 4배 증가 |

| 역량 | 침식 | 복리 성장 |

| 경제적 위치 | 매년 더 대체 가능 | 매년 더 대체 불가 |

| 결과 | "Cursor 없으면 코딩 못 하는 개발자" | "50명 팀 작업을 혼자 출고하는 창업자" |

Andrej Karpathy가 2026년 Sequoia Ascent에서 한 말을 빌리자면, 우리 역할은 오케스트레이터이자 감독자가 되어야 한다.4 AI가 타이핑하고, 당신은 사고한다. 단, 당신의 판단이 충분히 날카로울 때만 이 구도가 성립한다. 판단이 둔하면 당신은 무엇도 지휘하지 않는다. 도장이나 찍고 있을 뿐이다.

"당신의 판단이 약하면, 속도가 당신을 죽인다."

💭 이 글을 읽고 생각해볼 질문

-

지난 일주일을 정직하게 돌아보자. AI가 절약해 준 시간을 당신은 어디에 썼는가 — 더 어려운 문제로 향했는가, 아니면 스크롤로 흘려보냈는가?

-

MIT 연구의 4번째 세션은 한 가지 기준을 제시했다. 도구 없이 작업할 수 있는 '기존 구조'를 가진 사람만 AI로 증폭된다. 당신이 지금 다루는 문제 영역에서, 당신은 어느 쪽에 속하는가?

-

만약 내일 모든 AI 구독이 끊긴다면, 당신의 결과물 중 어떤 부분이 무너지는가? 그 무너지는 부분이 바로 당신이 아직 학습하지 못한 영역이다 — 이 사실을 어떻게 활용할 것인가?

댓글로 당신의 솔직한 답을 공유해주세요. 불편한 답일수록 좋습니다.

결론: 출고 속도는 같지만, 출고하는 사람은 다르다

AI 위에서 미끄러지듯 살 수는 없다. 아무도 AI 위에서 미끄러지지 못한다.

당신은 그것을 쓰면서 더 날카로워지거나, 더 둔해진다. 패턴은 단 하나의 규칙으로 압축된다.

"먼저 자신의 뇌를 가동시킨다. 그 다음에 채팅창을 연다."

처음에는 더 느릴 것이다. 사실 더 느리다. AI로 30분이 된 2시간짜리 작업이 사고를 다시 끼워 넣으면 45분이 된다. 시간이 지나며 얻는 것은 — 그 45분이 점점 똑똑해지는 사람을 만드는 동안, 30분짜리 버전은 점점 텅 비어가는 커서를 만든다는 사실이다.

복리는 양방향으로 작동한다. 당신은 어느 쪽이 돌아갈지를 선택하는 중이다.

"AI 시대에 살아남는 질문은 'AI가 무엇을 할 수 있는가'가 아니다. 'AI가 한 뒤에도 당신에게 무엇이 남는가'이다."

Sources

이 글이 도움이 되셨다면, 이 글이 가장 필요할 한 명의 친구에게 공유해주세요.

Footnotes

-

Your Brain on ChatGPT: Accumulation of Cognitive Debt | MIT Media Lab / arXiv:2506.08872 ↩

-

The Impact of Generative AI on Critical Thinking | Microsoft Research CHI 2025 ↩

-

More Students Use AI for Homework, and More Believe It Harms Critical Thinking | RAND ↩

-

Karpathy Declares Vibe Coding Obsolete, Introduces Agentic Engineering at Sequoia AI Ascent 2026 | Analytics Drift ↩