왜 나는 35B 모델을 맥북에서 돌릴 수 있게 됐을까: KV 캐시 양자화 쉽게 이해하기

🎧 Voice Briefing

📅 Generated: 2026. 4. 25. 오후 7:13:16

⏱️ Duration: ~155s

Links: 🔗 Open in Google Drive | 📥 Download

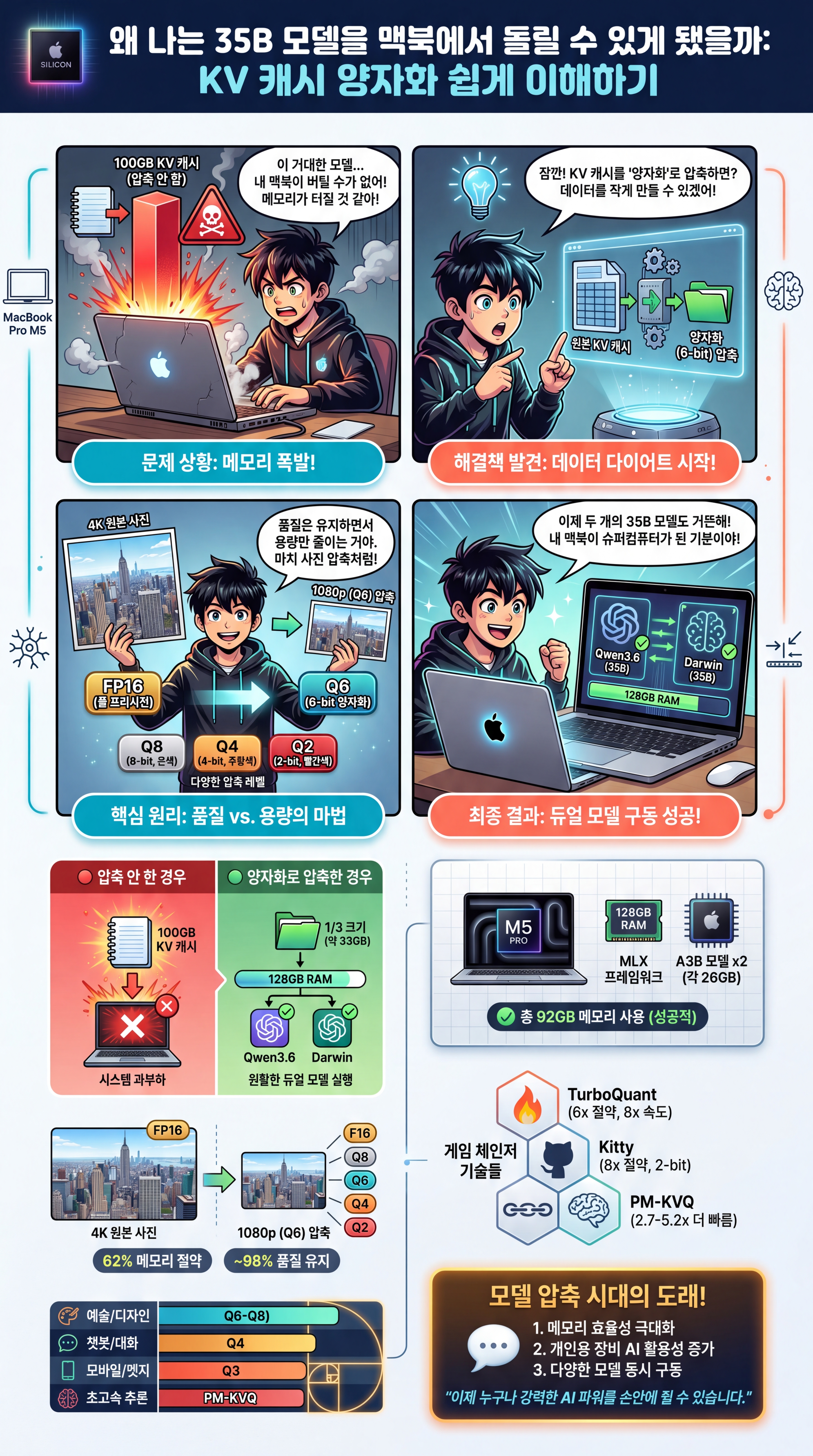

왜 나는 35B 모델을 맥북에서 돌릴 수 있게 됐을까: KV 캐시 양자화 쉽게 이해하기

프롤로그: AI는 정말 클라우드에만 있어야 할까?

ChatGPT를 쓰려면 인터넷이 필요하다. 클로드를 쓰려면 구독료가 필요하다.

그런데 만약, 당신의 맥북이 그 큰 모델들을 직접 돌릴 수 있다면?

지금 내 맥북에서는 두 개의 AI 모델이 항상 켜져 있다. Qwen3.6 35B A3B와 Darwin 35B A3B Opus MLX. 둘 다 6비트로 압축된 버전이다. 350억 개의 파라미터를 가진 모델 두 개가, 책상 위 노트북에서, 인터넷 없이, 무료로 돌아가고 있다.

3년 전이라면 이건 농담이었다. 2026년에는 현실이다. 그 이유의 핵심에 KV 캐시 양자화라는 기술이 있다. 이름은 어렵지만, 개념은 의외로 단순하다. 오늘 그 이야기를 해보려고 한다.

I – KV 캐시는 AI의 '메모장'이다

먼저 어려운 이름부터 풀어보자.

KV 캐시 = AI 모델이 대화를 기억하기 위한 메모장

당신이 ChatGPT와 대화할 때, AI는 지금까지 나눈 모든 말을 머릿속(?)에 기록해 둔다. "아, 사용자가 아까 강아지 얘기했지", "어제 회의 얘기했었지" — 이런 정보를 저장하는 곳이 KV 캐시다.

문제는 이 메모장이 의외로 두껍다는 것이다.

메모장이 책 한 권보다 무거울 수 있다.

예를 들어 LLaMA2-30B라는 모델은, 모델 자체가 60GB다. 그런데 긴 대화를 하다 보면 메모장(KV 캐시)이 100GB를 넘어간다.1 책보다 메모장이 더 무겁다는 이상한 상황이다.

이게 왜 문제냐면, 16GB 맥미니에서는 메모장 자체가 안 들어간다는 뜻이다. AI가 "잠깐 뭐였더라?" 하고 멈춰 버린다.

graph TD

subgraph 문제 ["🔴 압축 안 한 경우"]

A[긴 대화] --> B[메모장이 100GB로 부풀음]

B --> C[맥북 메모리 폭발]

end

subgraph 해결 ["🟢 양자화로 압축한 경우"]

D[메모장을 6비트로 줄임] --> E[크기가 1/3로 작아짐]

E --> F[35B 모델도 맥북에서 돌아감]

end

II – 양자화는 '사진 화질 줄이기'와 똑같다

양자화(Quantization)라는 단어, 무섭게 들리는데 사실 별거 아니다.

양자화 = 정보의 화질을 낮춰서 용량을 줄이는 일

스마트폰에서 사진을 보낼 때를 생각해 보자. 원본 사진은 5MB인데, 카톡으로 보내면 자동으로 500KB로 줄어든다. 화질이 살짝 떨어지지만, 보는 데는 지장 없다.

AI 모델도 똑같다. 원래 모델은 16비트(매우 정밀한 색)로 되어 있다. 이걸 8비트, 6비트, 4비트 등으로 줄이면 용량은 작아지고, 품질은 살짝 떨어진다.

| 압축 정도 | 메모리 절감 | 품질 유지 | 비유 |

|---|---|---|---|

| FP16 (원본) | 0% | 100% | 4K 원본 영상 |

| Q8 (8비트) | 50% 절약 | 99% | 1080p HD |

| Q6 (6비트) ← 내 모델 | 62% 절약 | ~98% | 1080p 살짝 압축 |

| Q4 (4비트) | 75% 절약 | 97% | 720p |

| Q2 (2비트) | 87% 절약 | 85% | 480p |

내가 쓰는 6비트 양자화는 사람들이 잘 모르는 스위트 스팟이다. 4비트보다 품질이 확실히 좋고, 8비트보다 메모리를 훨씬 덜 쓴다. 35B 같은 큰 모델을 맥북에서 쾌적하게 돌리고 싶을 때 딱 좋은 선택이다.

"양자화는 압축이 아니라 거래다. 메모리를 얻고, 미세한 정확도를 내준다."

III – 내 맥북에서 진짜 일어나는 일

자, 이론은 됐고. 실제 내 사례로 가보자.

🖥️ 내 셋업

| 항목 | 사양 |

|---|---|

| 맥북 | M5 Pro Max, 128GB 통합 메모리 |

| 모델 1 | Qwen3.6 35B A3B (6비트 양자화) |

| 모델 2 | Darwin 35B A3B Opus MLX (6비트 양자화) |

| 프레임워크 | Apple MLX |

여기서 잠깐 — A3B는 또 뭔가? 쉽게 말하면 "전체는 35B인데 한 번에 3B만 활성화되는 모델"이다. 큰 도서관 같은 모델인데, 질문에 따라 그때그때 필요한 책장에서만 책을 꺼내 쓴다. 그래서 빠르고 효율적이다.

📦 메모리 계산해보기

만약 양자화를 안 했다면:

- Qwen3.6 35B (FP16 원본): 약 70GB

- Darwin 35B (FP16 원본): 약 70GB

- 두 모델 합계: 140GB → 128GB 맥북에 안 들어감 ❌

6비트로 양자화하니:

- Qwen3.6 35B (Q6): 약 26GB

- Darwin 35B (Q6): 약 26GB

- KV 캐시 + OS: 약 40GB

- 합계: 약 92GB → 128GB에 두 모델 동시 구동 가능 ✅

이게 양자화의 마법이다. 같은 하드웨어에서, 같은 모델인데, 두 개를 동시에 켜놓고 쓸 수 있다.

IV – 2026년의 게임 체인저들

올해 KV 캐시 양자화 분야에서 두 번의 큰 도약이 있었다.

🔥 TurboQuant — 구글의 "마법의 압축기" (2026년 4월)

구글 딥마인드가 ICLR 2026에서 발표한 알고리즘. 16비트 데이터를 3비트까지 줄였는데, 정확도 손실이 거의 없다.2

| 비교 항목 | 결과 |

|---|---|

| 메모리 절약 | 6배 감소 |

| H100 GPU 속도 | 어텐션 연산 8배 빨라짐 |

| 정확도 손실 | 거의 없음 (오차 범위 내) |

발표 직후, 메모리 칩 회사들의 주가가 흔들렸다. 메모리를 덜 써도 된다는 건, 비싼 메모리를 덜 사도 된다는 뜻이니까.

🐱 Kitty — 2비트까지 밀어붙이기 (2025년 11월)

보통 2비트는 너무 작아서 모델이 바보가 된다. 그런데 Kitty는 똑똑한 트릭으로 그 한계를 깼다. 메모리 8배 절감, 정확도는 거의 그대로.3

"4비트는 안전하다. 2비트는 위험하다 — Kitty가 나오기 전까지는."

🧠 PM-KVQ — 긴 추론에 최적화

7B70B 모델이 복잡한 사고(Chain of Thought)를 할 때, 같은 메모리로 정확도를 8% 더 올렸다. 처리 속도는 16비트 모델보다 2.75.2배 빠르다.4

V – 그래서, 어떤 양자화를 골라야 할까

한 줄 요약: 용도에 따라 다르다.

| 용도 | 추천 양자화 | 이유 |

|---|---|---|

| 🎨 창작 / 코딩 | Q6 ~ Q8 | 디테일 중요, 내가 쓰는 셋업 |

| 💬 일반 대화 | Q4_K_M | 가장 인기 있는 기본값 |

| 📱 아이폰 / 작은 기기 | Q3 (Kitty 등) | 메모리 절약이 절대적 |

| 🧠 긴 추론 / 분석 | PM-KVQ | 캐시가 비대해지는 경우 |

| 🚀 회사에서 서비스 | FP8 + KV q8 | 안정성 우선 |

내가 6비트를 고른 이유? 창작과 코딩이 주 용도라서 디테일이 중요하다. 4비트로 내려가면 미묘한 뉘앙스가 살짝 흐려진다. 8비트는 메모리 너무 많이 먹는다. 6비트는 그 사이의 황금 비율이다.

모델, 작업, 하드웨어 — 이 세 가지가 양자화의 삼각형이다.

💭 이 글을 읽고 생각해볼 질문

-

만약 당신의 맥북이 GPT-4급 모델을 무료로 돌릴 수 있다면, ChatGPT 구독을 계속하시겠어요?

-

AI 응답이 '약간 흐릿해지는' 것을 어디까지 받아들일 수 있을까요? 글쓰기, 코딩, 의료 상담 — 각각 다를까요?

-

데이터가 클라우드를 떠나 내 기기에만 머무른다면, 우리의 프라이버시는 어떻게 달라질까요?

댓글로 당신의 생각을 들려주세요.

결론: AI가 내 책상 위로 내려오고 있다

한 달 전, 트위터에서 어떤 사람이 KV 캐시 트윗이 외계어 같다고 했다.5 솔직히 나도 그랬다. 하지만 그 외계어를 풀어보니, 거기엔 더 큰 이야기가 숨어 있었다.

더 큰 모델을 만드는 시대는 끝나가고 있다. 이제는 같은 모델을 더 작게, 더 똑똑하게 압축하는 시대다.

내 M5 맥북프로에서 35B 모델 두 개가 동시에 돌아간다는 건, 단순한 자랑이 아니다. AI가 데이터센터를 떠나 내 책상 위로, 내 손바닥 위로 내려오고 있다는 신호다. 인터넷이 끊겨도, 구독이 끊겨도, AI는 내 옆에 있다.

이게 진짜 AI 민주화다.

"가장 큰 모델이 이긴다는 건 거짓말이었다. 진짜 승자는 가장 잘 압축된 모델이다."

Sources

이 글이 도움이 되셨다면, 한 명의 친구에게 공유해주세요.