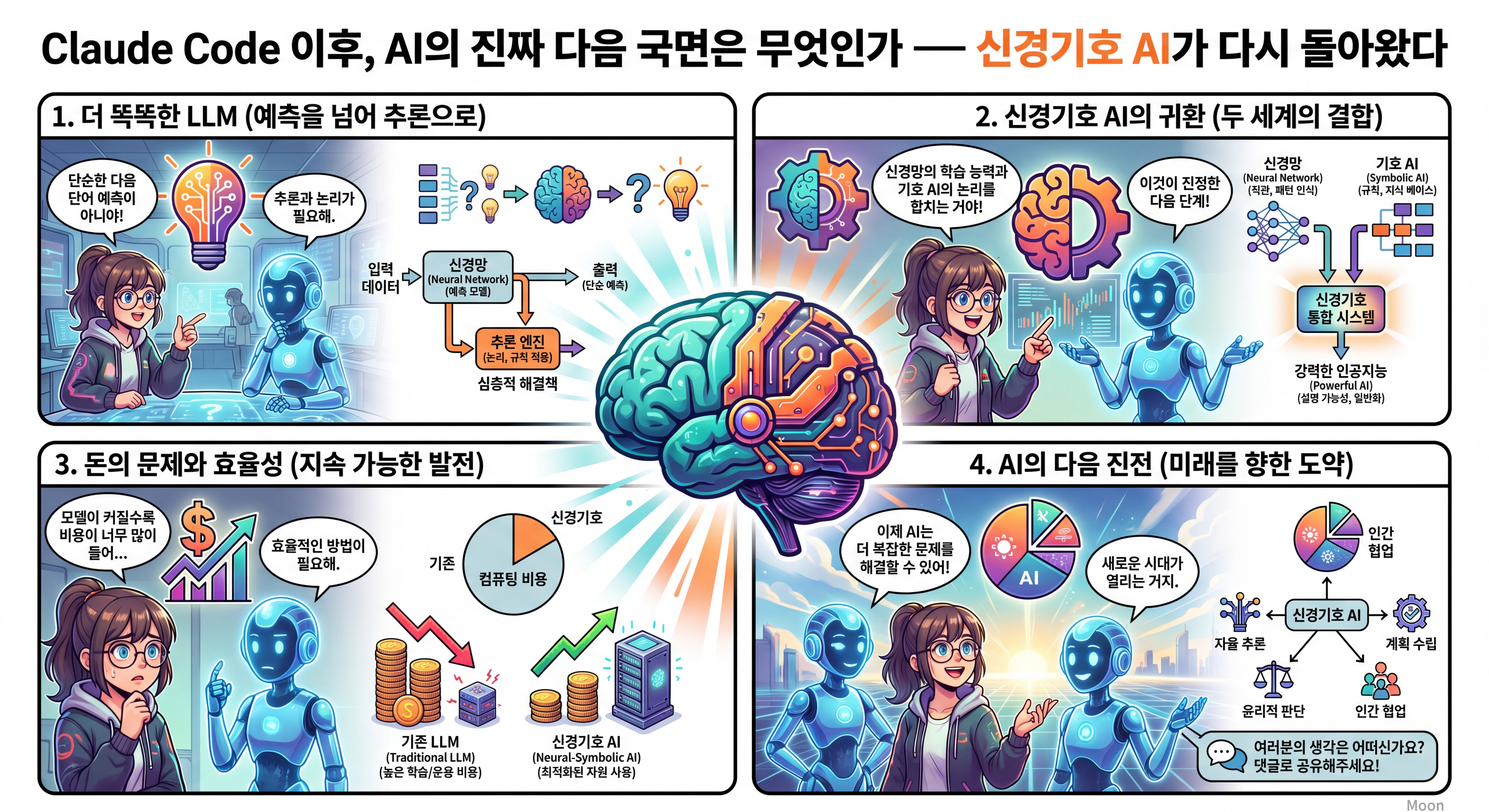

Claude Code 이후, AI의 진짜 다음 국면은 무엇인가 — 신경기호 AI가 다시 돌아왔다

🎧 Voice Briefing

📅 Generated: 2026. 4. 13. 오전 6:17:33

Claude Code 이후, AI의 진짜 다음 국면은 무엇인가 — 신경기호 AI가 다시 돌아왔다

프롤로그: 더 큰 모델이 아니라, 다른 구조가 시작됐는지도 모른다

모든 사람이 스케일링을 말한다.

더 큰 모델. 더 많은 토큰. 더 긴 컨텍스트. 더 높은 벤치마크 점수.

하지만 나는 지금, 다른 장면을 보고 있다고 생각한다.

Claude Code의 진짜 의미는 더 강한 LLM이 나왔다는 데 있지 않다. 순수 LLM만으로는 부족하다는 사실이 너무 분명해졌다는 데 있다.

Gary Marcus는 2026년 4월, Claude Code를 두고 “LLM 이후 가장 큰 AI 진전”이라고 평가했다1. 그의 핵심 주장은 단순하다. Claude Code는 순수한 딥러닝 시스템이 아니라, 신경망 위에 결정론적 제어와 기호적 구조를 얹은 하이브리드 시스템이라는 것이다.

이 주장이 과장처럼 들릴 수도 있다.

그런데 바로 그 점이 중요하다.

우리는 지난 몇 년 동안 “모델이 얼마나 커졌는가”만 물었다. 이제는 “모델 바깥에 어떤 구조를 붙였는가”를 물어야 할지 모른다.

I – Claude Code가 보여준 건 '더 똑똑한 LLM'이 아니라 '잘 설계된 시스템'이었다

원문이 던지는 가장 강한 메시지는 이것이다.

Claude Code는 잘 작동하는 이유가 단지 모델 자체가 좋아서가 아니라, 모델이 혼자 일하지 않게 만들었기 때문이라는 점이다.

Marcus는 유출된 소스 분석을 근거로, Claude Code 중심부에 있는 특정 커널이 거대한 조건문과 패턴 매칭 로직으로 구성되어 있다고 본다12. 물론 이것이 곧바로 “완전한 신경기호 AI의 승리”를 뜻하는지는 논쟁의 여지가 있다. 하지만 적어도 한 가지는 분명하다.

프론티어 AI를 실제 도구로 만들 때, 순수한 확률적 생성만으로는 부족하다는 사실을 Anthropic도 알고 있다는 점이다.

Anthropic의 공식 문서를 봐도 Claude Code는 단순 챗봇이 아니다. 터미널, 도구 호출, 에이전트 팀, MCP(Model Context Protocol), 장시간 작업 흐름을 포함하는 agentic coding tool로 설명된다3.

즉, 이 시스템의 실전 성능은 모델 하나가 아니라 다음의 결합에서 나온다.

- 신경망 기반 언어 추론

- 명시적 도구 호출

- 상태 관리

- 규칙 기반 흐름 제어

- 실패를 줄이기 위한 결정론적 안전장치

"미래의 경쟁 우위는 더 큰 모델이 아니라, 더 정교한 오케스트레이션에서 나올 수 있다."

여기서 핵심이 나온다.

우리는 지금까지 AI를 “뇌”로만 봤다. 하지만 실제 제품은 뇌만으로 돌아가지 않는다. 뇌 위에 붙는 손, 기억, 규칙, 절차, 감독 구조가 성능을 결정한다.

graph TD

subgraph OldFrame ["🔵 기존 프레임"]

A[더 큰 LLM] --> B[더 높은 점수]

B --> C[더 좋은 AI]

end

subgraph NewFrame ["🟢 새로운 프레임"]

D[신경망 추론] --> E[기호적 규칙]

E --> F[도구 호출]

F --> G[상태 관리]

G --> H[실전 성능]

end

이 차이는 사소하지 않다.

이건 모델 업그레이드가 아니라, 패러다임 업그레이드에 가깝다.

II – 신경기호 AI는 갑자기 나타난 유행이 아니다

Marcus의 글이 흥미로운 이유는, 이것이 단순한 제품 리뷰가 아니라 오래된 주장에 대한 뒤늦은 복권 선언이기 때문이다.

그는 수십 년 동안 AI가 결국 신경망과 기호 시스템의 결합으로 가야 한다고 말해왔다. 2020년 논문 The Next Decade in AI에서도, 단순한 통계적 상관관계만으로는 강건한 지능에 도달할 수 없고, 지식 표현·추론·세계모형이 반드시 필요하다고 주장했다4.

흥미로운 건, 이 주장이 더 이상 철학으로만 들리지 않는다는 점이다.

Google DeepMind의 AlphaProof와 AlphaGeometry 2도 명백히 하이브리드 구조다. DeepMind는 스스로 이를 neuro-symbolic hybrid system이라고 설명한다5. 2024년 IMO에서 이 조합은 은메달 수준 성과를 냈고, AlphaGeometry 2는 과거 IMO 기하 문제의 80% 이상을 해결했다5.

즉, Claude Code만의 이야기가 아니다.

최근 몇 년간 의미 있는 돌파들은 공통적으로 이런 구조를 가진다.

| 시스템 | 핵심 방식 | 의미 |

|---|---|---|

| Claude Code | LLM + 규칙/도구/제어 구조 | 실전 코딩 에이전트화 |

| AlphaGeometry 2 | 신경망 + 기호 추론 | 정형 수학 문제 해결 |

| AlphaProof | 신경망 + 형식 증명 시스템 | 엄밀한 증명 자동화 |

| Code Interpreter류 시스템 | LLM + 실제 코드 실행 | 계산/검증을 외부 기호 시스템에 위임 |

이 패턴은 하나의 사실을 말한다.

AI가 더 믿을 만해지는 순간은, 신경망이 모든 걸 혼자 하려는 순간이 아니라, 잘하는 것만 맡고 나머지는 구조화된 시스템에 넘기는 순간이다.

III – 왜 지금 이 논쟁이 중요해졌는가

이건 학술 취향의 문제가 아니다.

돈의 문제고, 신뢰의 문제고, 제품의 문제다.

원문에서 Marcus는 “capital allocation”이라는 표현을 쓴다. 매우 중요한 대목이다. 왜냐하면 지금까지 시장은 주로 이런 질문을 해왔기 때문이다.

“누가 더 큰 모델을 더 빨리 만들 수 있는가?”

하지만 Claude Code 같은 시스템이 보여주는 건 다른 질문이다.

“누가 신경망과 기호적 구조를 더 잘 결합해 실제로 일하는 시스템을 만들 수 있는가?”

이 질문으로 넘어가면 투자 지형도 바뀐다.

- 단순 모델 스케일링 기업만 유리한 것이 아니다.

- 툴링, 에이전트 인프라, 워크플로 오케스트레이션 기업의 가치가 커진다.

- 검증 가능한 추론, 명시적 제어, 도메인 지식 결합이 중요한 산업에서 판이 다시 짜인다.

여기서 나는 하나의 역설을 본다.

사람들은 여전히 “더 큰 모델”을 미래라고 믿지만, 실제로 돈을 버는 제품은 점점 “더 잘 짜인 구조” 쪽에서 나오고 있다.

Marcus가 맞는지, 그가 조금 과장하고 있는지는 부차적일 수 있다.

더 본질적인 건, 이제 업계 스스로가 그 방향으로 움직이고 있다는 점이다.

"스케일링은 여전히 중요하다. 하지만 더 이상 혁신의 전부는 아니다."

이 말은 조심해서 읽어야 한다.

스케일링이 끝났다는 뜻이 아니다. 스케일링 만으로는 차별화가 어려워졌다는 뜻이다.

IV – 다음 AI는 '말을 잘하는 모델'이 아니라 '구조를 가진 시스템'일 것이다

나는 이 글의 진짜 가치를 여기서 본다.

Marcus는 Claude Code를 칭찬하면서도, 동시에 그것이 아직 충분하지 않다고 말한다. 진짜로 신뢰 가능한 AI에 가려면, 신경기호 접근은 시작점일 뿐이고 그 위에 더 나은 지식 구조, 추론 메커니즘, 세계 모델이 필요하다는 것이다14.

이건 비판이 아니라 방향 제시다.

다시 말해 Claude Code는 완성형이 아니다. 하지만 중요한 신호일 수 있다.

AI의 다음 큰 진전은 “더 많은 말”이 아니라 “더 많은 구조”에서 올 가능성이 높다.

우리는 이미 그 조짐을 보고 있다.

- 순수 생성에서 에이전트 시스템으로

- 단일 모델에서 멀티툴 협업으로

- 확률적 응답에서 검증 가능한 절차로

- 블랙박스 성능에서 구조화된 신뢰성으로

pie title AI의 다음 진전은 어디서 오는가

"모델 스케일링" : 35

"에이전트 구조화" : 25

"기호적 제어와 검증" : 20

"지식·세계모형 통합" : 20

이 변화는 느리게 오지 않을 것이다.

왜냐하면 사용자도, 기업도, 투자자도 이제 “와, 잘 말하네”에 감탄하는 단계를 지나고 있기 때문이다.

이제 모두가 묻는다.

- 믿을 수 있는가?

- 재현 가능한가?

- 오류를 줄일 수 있는가?

- 실제 업무에서 책임질 수 있는가?

이 질문에 답하려면, 결국 구조가 필요하다.

💭 이 글을 읽고 생각해볼 질문

-

신경기호 AI는 정말 차세대 패러다임일까, 아니면 거대한 LLM 위에 덧댄 엔지니어링 최적화일 뿐일까?

-

앞으로 AI 경쟁의 승부는 모델 크기보다 시스템 설계 능력에서 갈릴 가능성이 얼마나 클까?

-

신뢰 가능한 AI를 만들기 위해, 우리는 더 큰 모델보다 더 나은 지식 구조와 추론 구조에 먼저 투자해야 할까?

댓글로 당신의 생각을 공유해주세요.

결론: 우리는 AI의 '뇌'만 봐왔고, 이제는 '골격'을 봐야 한다

LLM은 분명 거대한 진전이었다.

하지만 그 다음 진전은 어쩌면 더 큰 모델이 아닐 수 있다.

Claude Code를 둘러싼 Marcus의 해석은 논쟁적이다. 그렇기 때문에 오히려 가치가 있다. 그는 지금 우리가 너무 당연하게 받아들이고 있던 전제를 흔든다.

AI의 미래는 더 거대한 신경망 하나가 아니라, 신경망이 무엇을 하고 무엇을 하지 않게 설계하느냐에 달려 있을지도 모른다.

나는 이 문장을 조금 더 일반화하고 싶다.

우리는 지난 몇 년간 AI의 뇌를 키워왔다.

이제는 골격을 설계할 차례다.

"다음 혁신은 더 높은 점수에서 오지 않는다. 더 믿을 수 있는 구조에서 온다."

그리고 바로 그 순간부터, AI는 단순한 생성 엔진에서 진짜 시스템으로 넘어가기 시작할 것이다.

Sources

이 글이 도움이 되셨다면, 한 명의 친구에게 공유해주세요.

Footnotes

-

The biggest advance in AI since the LLM | Gary Marcus ↩ ↩2 ↩3

-

The Snake That Ate Itself: What Claude Code's leaked source reveals | Techtrenches ↩

-

The Next Decade in AI: Four Steps Towards Robust Artificial Intelligence | arXiv ↩ ↩2

-

AI solves IMO problems at silver-medal level | Google DeepMind ↩ ↩2