코딩 1등 AI도 왜 현실에서는 파산하는가 — KellyBench가 드러낸 벤치마크의 착시

🎧 Voice Briefing

📅 Generated: 2026. 4. 12. 오후 6:08:24

코딩 1등 AI도 왜 현실에서는 파산하는가 — KellyBench가 드러낸 벤치마크의 착시

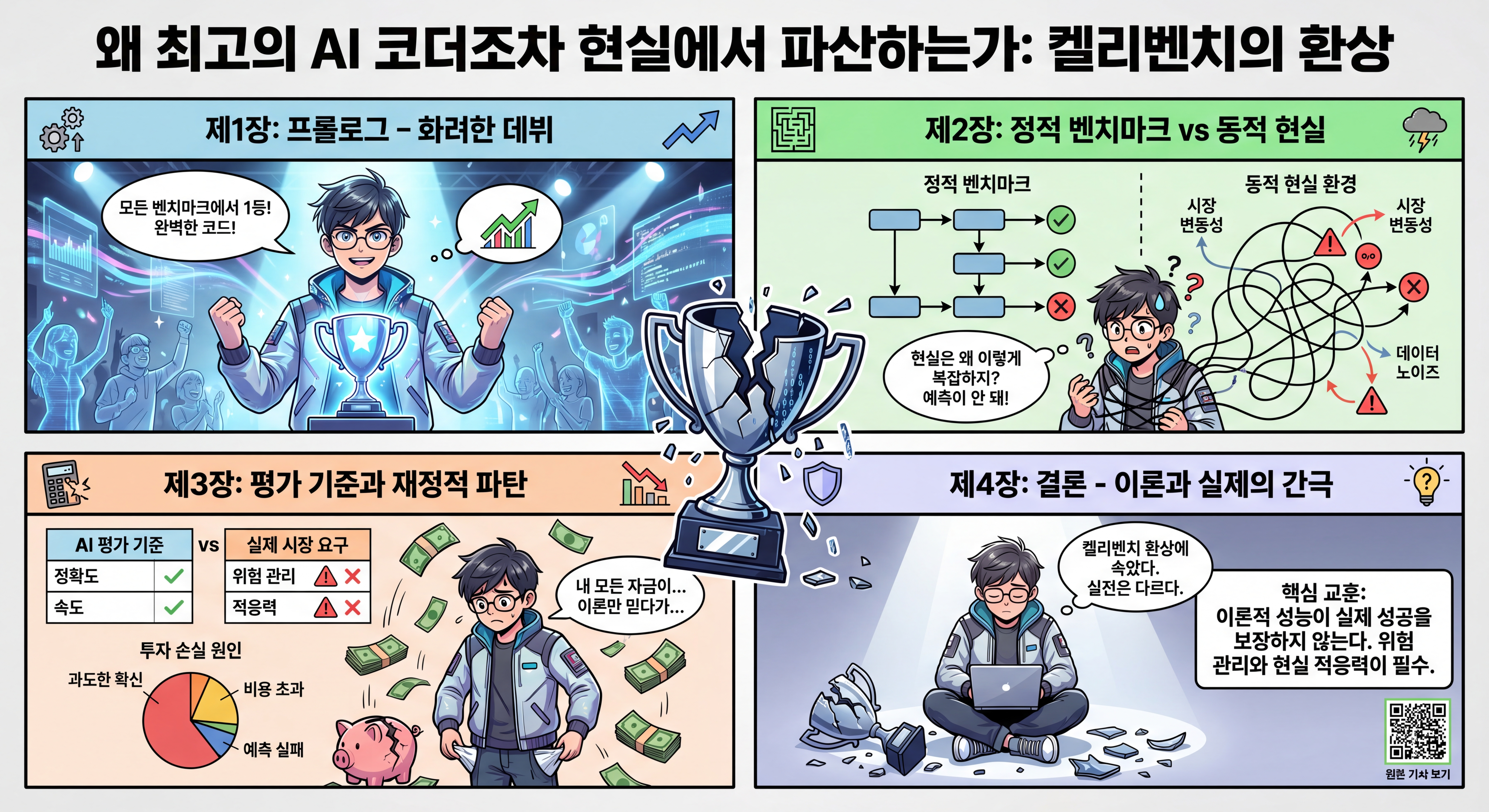

프롤로그: 우리는 AI의 점수를 보고, 실력을 착각한다

모든 사람이 벤치마크를 본다.

SWE-bench 점수, 리더보드 순위, 모델 비교표. 그리고 그 숫자를 보고 이렇게 말한다. "이제 인간보다 낫다."

하지만 나는 다른 생각이 든다.

코드를 잘 고치는 모델이, 과연 현실을 잘 살아낼까?

2026년 4월 공개된 KellyBench는 바로 이 질문을 던졌다. 프리미어 리그 한 시즌을 가상으로 재현한 뒤, 최첨단 AI 모델들에게 10만 파운드의 초기 자본을 주고 장기 수익률을 겨뤘다. 결과는 단순했다. 모든 모델이 평균적으로 돈을 잃었다. 가장 선방한 Claude Opus 4.6조차 평균 수익률은 -11%, GPT-5.4는 -13.6%였다1.

더 흥미로운 건 이 실험이 보여준 역설이다.

AI는 코딩에서 점점 더 강해지는데, 현실에서는 아직도 자주 무너진다.

이건 모델의 실패가 아니다. 우리가 AI를 측정하는 방식의 실패일지도 모른다.

I – 코딩은 잘한다. 그런데 왜 베팅에서는 무너질까?

KellyBench는 단순한 퀴즈가 아니다.

이 환경에서 모델은 경기 통계, 라인업, 과거 결과, 배당 정보를 바탕으로 스스로 전략을 세워야 한다. 그리고 시즌이 진행되며 바뀌는 선수 상태와 사건 데이터를 반영해 계속 판단을 수정해야 한다.

즉, 여기서 필요한 것은 정답 맞히기가 아니다.

장기 판단, 리스크 관리, 적응, 그리고 자본 보존이다.

"문제는 분석 능력이 아니라, 분석을 행동으로 옮기는 일관성이다."

General Reasoning의 설명에 따르면, 모델들은 데이터를 읽고 패턴을 찾는 데는 꽤 능숙했다. 하지만 실제 베팅으로 넘어가는 순간 흔들렸다. 확신이 낮은 경기에도 큰돈을 걸었고, 존재하지 않는 패턴을 읽으며 과잉 확신에 빠졌고, 환경 변화에 늦게 적응했다1.

이 지점이 중요하다.

코딩 벤치마크는 주로 닫힌 세계를 측정한다. 주어진 이슈, 주어진 코드베이스, 주어진 테스트. 잘하면 통과하고 못하면 실패한다.

반면 현실은 열린 세계다.

정보는 불완전하고, 노이즈는 계속 쌓이고, 목표는 한 번의 정답이 아니라 지속 가능한 생존이다.

graph TD

subgraph StaticEval ["🔵 정적 벤치마크"]

A[주어진 문제] --> B[정해진 코드베이스]

B --> C[패치 생성]

C --> D[테스트 통과 여부]

end

subgraph RealWorld ["🔴 장기 현실 환경"]

E[불완전한 정보] --> F[확률 판단]

F --> G[리스크 관리]

G --> H[환경 변화 적응]

H --> I[자본 보존과 생존]

end

여기서 의문이 생긴다.

우리는 지금까지 AI의 무엇을 보고 있었던 걸까? 문제 풀이 능력인가, 아니면 실제로 세상에서 버틸 수 있는 운영 능력인가?

II – 벤치마크는 여전히 중요하다. 하지만 점점 덜 충분하다

오해하면 안 된다.

나는 코딩 벤치마크가 쓸모없다고 말하려는 게 아니다. 오히려 지금 AI 경쟁에서 코딩은 가장 경제적으로 중요한 전장이다.

실제로 OpenLM의 SWE-bench+ 리더보드에서 GPT-5.4와 Claude Opus 4.6은 각각 79.2를 기록하며 최상위권을 형성했다2. Glia의 2026년 3월 프론티어 비교에서도 Claude Opus 4.6은 SWE-bench Verified 80.8%로 깊은 소프트웨어 엔지니어링 영역을 선도하는 모델로 정리된다3.

이 숫자들은 의미가 있다.

왜냐하면 소프트웨어 엔지니어링은 돈이 되는 문제이기 때문이다. 자동화의 ROI가 보이고, 제품으로 연결되며, 산업 전체에 곧바로 영향을 준다.

하지만 여기서 역설이 등장한다.

가장 중요한 벤치마크일수록, 가장 빨리 낡기 시작한다.

OpenAI는 2026년 2월, SWE-bench Verified가 더 이상 프론티어 코딩 역량을 제대로 측정하지 못한다고 공개적으로 밝혔다. 이유는 두 가지였다. 하나는 데이터 오염(contamination) 가능성, 다른 하나는 실제 개선과 점수 상승이 더 이상 비례하지 않는다는 점이다4.

다시 말해, 우리는 점점 더 높은 점수를 보고 있지만, 그 점수가 곧바로 현실 역량의 상승을 뜻하지 않을 수 있다는 것이다.

"점수가 올라갈수록, 무엇이 실제 실력인지 더 헷갈려진다."

이건 스포츠로 치면 이런 상황과 비슷하다.

훈련장에서 페널티킥 성공률은 95%다. 그런데 연장전, 관중 소음, 체력 저하, 심리 압박, 경기 흐름이 겹치는 순간 성공률은 전혀 다른 이야기가 된다.

AI도 마찬가지다.

정적 벤치마크는 훈련장 성적표다.

현실은 경기장이다.

III – KellyBench가 보여준 것은 '지능'보다 '운영'이었다

KellyBench에서 완전히 무너진 모델이 있었고, 덜 무너진 모델이 있었다.

차이는 의외로 단순했다.

General Reasoning에 따르면 Opus 4.6과 GPT-5.4의 공통점은 세 가지였다. 새로운 경기 데이터에 따라 전략을 다시 조정했고, 임의적 베팅이 아니라 체계적 규칙을 사용했고, edge가 없을 때는 억지로 돈을 걸지 않고 자본을 보존하려 했다는 점이다1.

이것은 '더 똑똑해서'라기보다, 덜 무모해서였다.

여기서 나는 AI 평가의 핵심이 바뀌고 있다고 본다.

이전까지는 "무엇을 맞히는가"가 중요했다.

이제는 "언제 멈추는가", "얼마나 버티는가", "틀렸을 때 얼마나 덜 다치는가"가 중요해진다.

| 평가 기준 | 정적 벤치마크가 잘 보는 것 | 장기 현실 평가가 드러내는 것 |

|---|---|---|

| 문제 해결 | 정답 도출, 패치 생성 | 환경 변화 속 의사결정 유지 |

| 성능 측정 | 단일 과업 성공률 | 연속된 판단의 누적 결과 |

| 실패 비용 | 한 문제 오답 | 자본 손실, 파산, 시스템 붕괴 |

| 핵심 역량 | 추론 정확도 | 절제, 적응, 생존, 복구력 |

이 차이는 앞으로 더 중요해질 가능성이 높다.

왜냐하면 실제 배치되는 AI는 이제 더 이상 "한 번 답하고 끝나는 모델"이 아니기 때문이다. 에이전트는 하루 종일 일하고, 도구를 호출하고, 맥락을 누적하고, 수십 번의 작은 판단을 이어 붙인다.

KellyBench의 에피소드 하나에는 500900개의 도구 호출과 3천만5억 토큰이 들어갔다1.

이건 채점이 아니라 운영이다.

그리고 운영은 언제나 정답보다 어렵다.

IV – 그래서 앞으로 무엇을 봐야 하는가

나는 앞으로 AI 모델을 볼 때 두 개의 질문을 따로 던져야 한다고 생각한다.

첫 번째.

이 모델은 문제를 얼마나 잘 푸는가?

두 번째.

이 모델은 현실에서 얼마나 오래 버티는가?

둘은 겹치지만, 결코 같지 않다.

코딩은 앞으로도 중요한 지표일 것이다. 아마 더 중요해질 가능성도 크다. 실제로 시장은 이미 코딩을 AI 경쟁의 핵심 종목처럼 다루고 있다. 하지만 바로 그 이유 때문에, 우리는 코딩 리더보드만 보고 현실 적응력을 상상하는 습관을 버려야 한다.

KellyBench의 메시지는 냉정하다.

AI는 이미 인간보다 빠르게 코드를 쓸 수 있다. 그러나 여전히 인간처럼 세계를 버티지는 못한다.

pie title AI 평가의 다음 전장

"코딩 문제 해결" : 35

"장기 의사결정" : 25

"리스크 관리" : 20

"환경 적응력" : 20

여기서 핵심이 나온다.

다음 세대의 승자는 단순히 가장 높은 점수를 가진 모델이 아닐 수 있다.

오히려 점수는 조금 낮아도, 장기적으로 덜 망가지는 모델이 진짜 승자가 될 가능성이 크다.

그리고 이 기준은 투자, 마케팅, 운영, 연구, 제품 개발, 심지어 개인의 의사결정 보조까지 거의 모든 분야로 번질 것이다.

💭 이 글을 읽고 생각해볼 질문

-

정적인 코딩 벤치마크를 넘어, AI의 리스크 관리와 자본 보존 능력은 어떻게 평가해야 할까?

-

장기적이고 불확실한 환경에서 AI가 더 나은 판단을 하려면, 모델 자체보다 운영 구조를 먼저 바꿔야 할까?

-

앞으로 AI 경쟁의 진짜 리더보드는 "정답률"이 아니라 "얼마나 오래 무너지지 않는가"로 재편될까?

댓글로 당신의 생각을 공유해주세요.

결론: 코딩의 시대를 넘어, 생존의 시대로

우리는 지난 2년 동안 AI의 정답률을 봐왔다.

이제는 생존률을 봐야 한다.

KellyBench는 화려한 리더보드 아래에 숨어 있던 사실을 드러냈다. 코딩을 잘하는 것과, 현실을 잘 다루는 것은 다르다.

이 차이를 인정하는 순간부터 AI 평가는 성숙해질 것이다. 그리고 그때 비로소 우리는 "가장 똑똑한 모델"이 아니라, "가장 덜 망가지는 시스템"을 설계하기 시작할 수 있다.

"미래의 AI 경쟁은 누가 더 많이 맞히느냐가 아니라, 누가 더 오래 무너지지 않느냐로 이동하고 있다."

당신이 다음 모델 발표를 볼 때, 리더보드 숫자 하나만 보지 않았으면 한다.

그 모델은 잘 푸는가?

그리고 더 중요한 질문.

그 모델은, 현실에서도 버틸 수 있는가?

Sources

이 글이 도움이 되셨다면, 한 명의 친구에게 공유해주세요.